다음으로 SLAM 의 종류를 알아보고자 한다.

SLAM은 대표적으로 VSLAM(Visual SLAM), LiDAR SLAM, RADAR SLAM, Sensor Fusion SLAM 으로 구분할 수 있다.

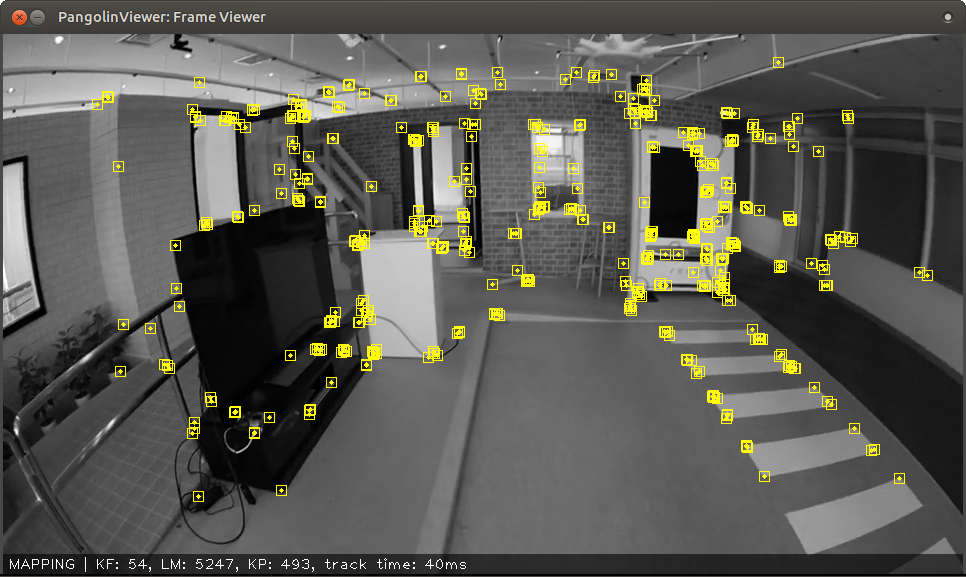

VLSAM

이름 그대로 Visual SLAM. 즉 이미지에 기반해서 위치를 추정하고 지도를 생성하는 SLAM 이다.

이미지를 활용하니까 카메라를 활용하는 것이고, 그러다보니 가격대에서 다른 SLAM에 비해 뚜렷한 장점이 있다.

카메라를 활용하다 보니까 데이터 핸들링이 쉽고, 딥러닝 이미지 처리와 연계가 쉽다는 장점이 있다.

하지만 사진에서 조명, 빛이 중요하듯이 빛 변화에 대응이 어려우며 그래서 당연하게도 어두운 곳에서 사용이 불가능하다는 치명적인 한계가 존재한다.

VSLAM은 카메라의 수에 따라 세분화되는데

먼저 1개의 카메라를 활용하는 경우, 매우 저렴하지만 Depth 에 대한 추정이 불가능해서 자율주행에서는 사실상 활용이 불가능하다.

그래서 간단한 모델링 정도에만 활용이 되는데, (예전 연구실에서 간단하게 아이폰을 활용해서 VSLAM을 진행했던 기억이 난다) 비율이 계산이 안되므로 이게 큰 장소인지, 작은 장소인지 구분이 안된다는 한계가 있다.

그러면 이걸 왜쓰냐? 일단 효율이 매우 뛰어나기 때문이다. 간단하게 카메라 1개, 2개를 붙이는게 아니고 이걸 처리해주는 전력, 컴퓨팅 구조 이런 부분들을 고려해야하는데 카메라가 1대이기 때문에 해당 구조에서 굉장한 효율을 보인다.

2개 또는 그 이상의 카메라를 활용하는 VSLAM의 경우, 삼각측량이 가능하므로 거리 및 깊이에 대한 추정이 가능하다. 물론 RTK나 LiDAR 처럼 정밀하지는 않지만, 기존의 1개를 활용했을 때 보다 3차원 구현이 가능해진다는 장점이 있다. 하지만 2개의 카메라 촬영 시점이 동일(싱크로나이즈)해야 하며, 교정(calibration)이 쉽지 않은 편이다. 또한, 연산량이 복잡해진다는 한계가 존재한다. 쉽게 말해서 무겁다.

다음으로 RGB 이미지와 Depth 이미지를 합친 RGB-D SLAM이 있는데, 해당 모델에서는 적외선 밴드를 활용해서 깊이를 나타낸다. 다만 거리가 표현 가능한 짧아서 자율주행처럼 몇 백미터 앞을 봐야하는 상황에서는 활용이 어렵다. 그리고 적외선이 태양광에서 겹치는 경우가 발생해서 실외에서는 사실상 사용이 불가능하다. 그래서 실내 가까운 거리에서 활용할 수 있는 로보틱스에서 주로 활용된다.

그리고 IMU를 활용하는 Visual0inertial SLAM이 있는데, VSLAM에 IMU를 활용했다고 보면 된다. 그래서 카메라로 SLAM이 안되는 경우, IMU를 활용하기 떄문에 비율, 지도 등 더 나은 결과를 도출할 수 있지만, 두 메커니즘에 대한 캘리브레이션과 노이즈 처리에 어려움이 있다.

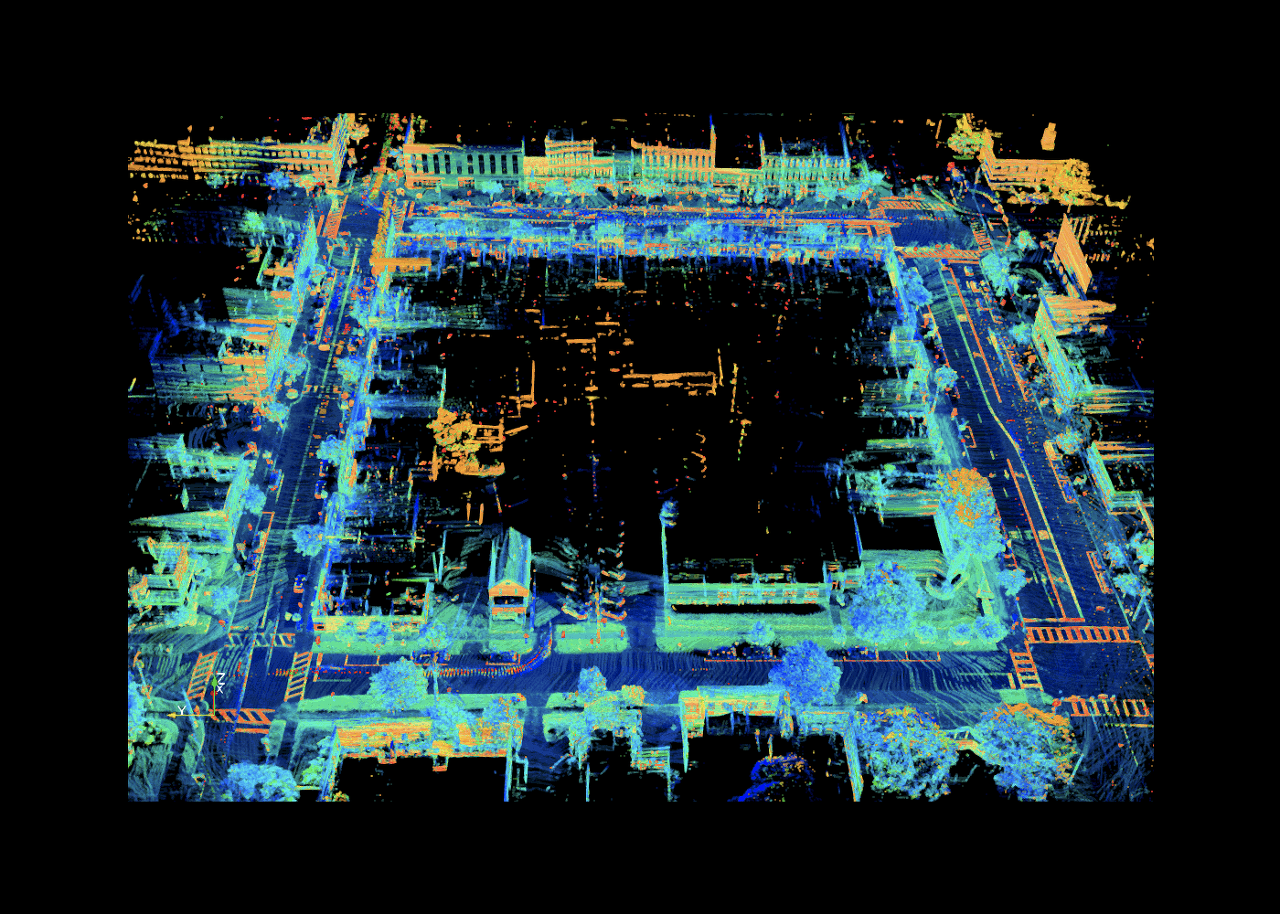

LiDAR SLAM

LiDAR SLAM은 말 그대로 LiDAR 포인트 클라우드 정보를 정합하는 방식이다.

LiDAR 포인트 클라우드를 활용하기 떄문에 3D geometry를 포함하고 고정밀하다. 또한 범위도 넓고 레이저를 활용하므로 밤에도 수행이 가능하다. 하지만 큰 단점이 비싸다.

사진만 봐도 뭔가 익숙한 3D 모델링같은것이 바로 LiDAR SLAM이다. 아무래도 정확하기 때문에 가장 많이 시각화해서 본 경험이 있을 것이다.

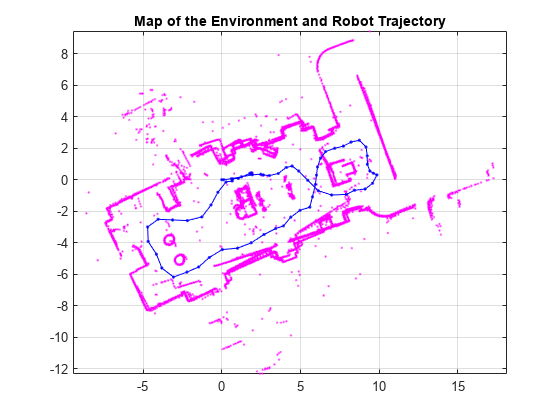

LiDAR SLAM의 경우, 2D, 3D 그리고 IMU를 사용하는 SLAM 이 있다.

2D LiDAR SLAM은 2D 지도를 얻기 쉽다는 장점이 있다. 대신 거리가 짧고, z값을 추정할 수 없다는 한계가 있어서, 실내 로봇에서 주로 활용한다. 굳이 z값이 필요 없다면 2D LiDAR SLAM으로도 충분하다. 실제로 오랜 기간 연구되었고, 상용화도 비교적 많이 되었다.

3D LiDAR SLAM이 가장 익숙한 모델일 것으로 예상한다. 3D 공간을 매우 고정밀하게 맵핑할 수 있어서 디지털 트윈과 유사한 환경을 마련할 수 있다. 하지만 구축 비용이 너무 비싸다는 한계가 있고, 색상에 대한 정보는 활용할 수 없다. 그래서 이를 이미지와 함께 구축해서 입히는 경우도 있다.

마지막으로 LiDAR-inertial SLAM은 IMU를 함꼐 활용한 것으로, 당연히 LiDAR + IMU 니까 성능면에서는 가장 좋을 것이다. 특히 모션을 인식하기 떄문에 반대쪽 차가 오든, 사람이 움직이든 정확한 정합이 가능하다.

하지만 캘리브레이션이 특히 어렵다는 한계가 존재한다.

RADAR SLAM

레이더 센서를 기반으로 하는 RADAR SLAM은 전자기파를 사용하여 주변 환경을 감지하기 때문에 날씨와 조명에 영향을 덜 받는다는 장점이 있다. 또한, 속도에 대한 감지가 가능하고 처리가 쉽다는 장점이 있다.

하지만 작은 물체에 대한 구별이 어렵고, 멀티패스의 한계, 노이즈에 대한 처리가 어렵다는 단점이 있다.

Sensor Fusion SLAM

Sensor Fusion SLAM은 말 그대로 여러 센서를 융합해서 활용하는 것으로 LiDAR, RADAR, IMU, GNSS 등 가능한 다양한 센서의 장점을 종합한 SLAM이다.

그러다보니 연산 처리가 어려워서 실시간 처리는 불가능하고, 데이터를 수집한 후에 나중에 데이터 처리를 하는 과정을 거친다. 각 센서의 장점만을 활용하기 때문에 당연히 가장 정확한 map 제작이 가능하다는 강력한 무기가 있지만, 여러 센서를 활용하는 만큼 비용이 배로 들어가며 캘리브레이션의 한계가 있다.

왜 HD-Map이나 정밀도로지도를 쓰지?

SLAM을 공부하면서, 그렇다면 HD Map이나 정밀도로지도를 왜 만들까? 하는 의문이 들었다.

테슬라도 SLAM을 활용하고(이미지 기반의), 결국 Localization과 Mapping을 하면 주행에 큰 문제가 없을텐데.

도대체 왜 그 공을 들여가면서 HD Map을 만들고 갱신하고 하는 것일까?

정답은 정확도의 향상, 오차 감소, 의사결정, 비용 등 여러 이유가 있을 것이다.

HD-Map을 활용해 Localization을 하면 매우 정확한 지도를 갖고 있기 때문에 역시 더욱 정밀한 위치 추정이 가능해 질 것이고, 당연하게 센서의 한계를 극복하니 오차가 줄어들 것이다.

그리고 도로 정보들이 있으니 의사결정과정에서 영향을 하게 되고, LiDAR 의 보급이 쉽지 않은 현실로 비용적인 측면에서 절감이 될 것이다.

또한, 신호등, 속도제한과 같이 메타데이터에 대해 매 순간 센서가 작동하고 데이터를 처리해야하면 이게 굉장한 부담이 될 수 있는데, 이런 부분에서 미리 제공된 고정밀지도가 있다면 큰 효율을 보일 것이다.

하지만 역시 한계가 존재한다. 정밀도로지도의 유지보수, 갱신 기간은 어떻게 할 것인가? 실제로 TSLA가 기존 정밀지도에 의존하지 않고 자율주행을 선보이고 있기 때문에 이러한 한계가 좀 크게 느껴진다.

정리해보면 아직 자율주행분야에서 정답은 없다는 것이다. 누가 옳은 것도, 누가 틀린 것도 아니다. 그저 결국 목적은 사람이 안전하게 활용해야 하는 것이니, 어떤 방법이든 안전하고 좋으면 되는 것이다(물론 경제적 측면도 고려해야하지만).

'자율주행' 카테고리의 다른 글

| [01] SLAM? (1) | 2023.12.28 |

|---|